MałySEO #47: Rok Potężnych Checklist [27 materiałów]

Spis treści:

Rok Potężnych Checklist

Ciekawe materiały o SEO

Raporty, badania, case studies

Newsy z branży SEO i AI

Postaw mi kawkę

Rok Potężnych Checklist

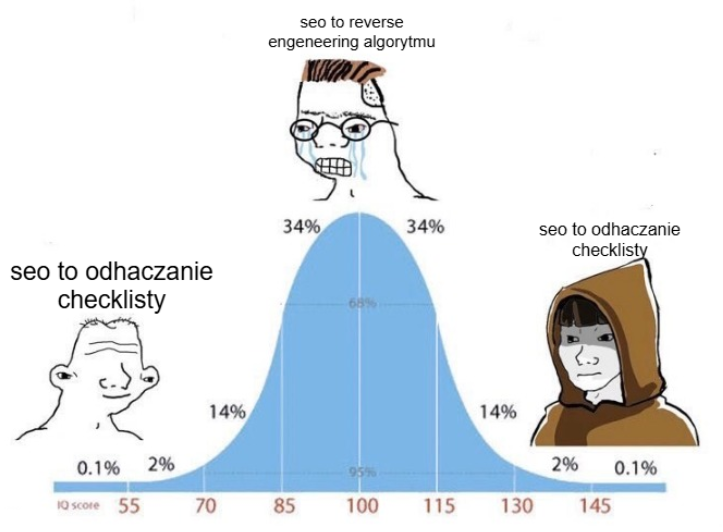

Odejdę lekko od polityki ograniczania treści MałySEO Newslettera do tekstu i podzielę się MEMEM. Wyjątkowo nie potrafię bowiem przekazać słowami wystarczająco precyzyjnie tego, co trzeba przekazać w kwestii korzystania z checklist w działaniach SEO.

Po prostu przychodzi taki moment, w którym wykorzystanie tej czy innej checklisty nie jest korzystaniem z PROSTEGO PRZEPISU NA TOP1, KTÓRY ZASTĄPI ZESPÓŁ SPECJALISTÓW [SEOWCY GO NIENAWIDZĄ], lecz zwyczajną koniecznością dopilnowania, że nie zapomniało się o żadnym istotnym szczególe spośród miliona istotnych szczegółów.

A tak się składa, że trwający rok ma szansę stać się Rokiem Potężnych Checklist. Obecna generacja LLM-ów (a przynajmniej Claude i Gemini, za produkt OpenAI nie dałbym sobie ręki uciąć) jest już na tyle dobra w strukturyzowaniu informacji i przenoszeniu ich do formatu .xlsx, że z dużą dozą prawdopodobieństwa czeka nas w najbliższych miesiącach zalew wszelkiego rodzaju checklist.

Z jednej strony fajnie, bo wiadomo. Z drugiej strony jednak oddzielenie wartościowych materiałów od tylko wyglądającego na wartościowy AI slopu będzie wymagało naprawdę sporo wysiłku, na który możemy nie mieć czasu ani siły. Taka mnie naszła myśl, gdy przeglądałem dwie potężne checklisty dotyczące E-E-A-T: jedną przygotowaną przez ekipę Ahrefs i drugą zaproponowaną przez Steve’a Totha. Mam do tych źródeł zaufanie, ale i tak odczuwam pewien dyskomfort związany z niepewnością, czy jest to dzieło sensowne, czy tylko tak wygląda.

Nota bene fajnie się obserwuje wewnętrznie, jak może zmieniać się podejście do materiałów generowanych przy użyciu AI.

Jeszcze za czasów przejścia z davinci na gpt-3 byłem przekonany, że nie będzie się to za bardzo do niczego nadawało, jeśli chodzi o generowanie treści i analiz jakości wyższej niż zapleczowa.

Wraz z kolejnymi, coraz lepszymi modelami moje wahadełko wychyliło się w kierunku “w sumie co to za różnica, czy AI, czy nie AI, jak ktoś użyje z głową, to bez różnicy”.

Paradoksalnie, wraz z nadejściem obecnej generacji (GPT 5.X, Sonnet/Opus 4.X, Gemini Flash/Pro 2.5-3.0) wracam do olbrzymiego sceptycyzmu. Zapewne trochę wpływ miało na to zagłębienie się w AI slop związany z grudniowym Core Update’em, trochę olbrzymie doświadczenie praktyczne z pracą z każdym istotnym LLM-em, trochę wyuczona nieufność, a trochę wrodzony neurotyzm 😀

Cokolwiek jednak by nie przeważało, mam obecnie olbrzymi problem z odbieraniem perfekcyjnie ustrukturyzowanych treści i milion razy bardziej cenię nawet najbardziej chaotyczny tok myślowy człowieka niż ładnie wyglądające zestawienie obrobione przez AI. Do tego stopnia, że mój mózg zaczął niemal automatycznie klasyfikować każdy sterylny tekst “łatwy do skanowania wzrokiem” jako w najlepszym wypadku podejrzany, a znacznie częściej - bezwartościowy.

To prowadzi mnie zaś do kolejnego zestawu ciekawych rozkmin. Istnieje oczywiście szansa, że tylko ja tak mam, ale z drugiej strony efekt doliny niesamowitości w obcowaniu z contentem tekstowym nie byłby aż taki dziwny. Czy czas na to, aby w dobie chunkowanego atomic contentu, zgodnego z zasadami web-writingu (łojezu, jak ja ich nie szanuję), zacząć mówić także o over-design content i zacząć myśleć nad mikro-chaosem, dygresyjnością, asymetrią i arytmicznością? Zdecydowanie do przemyślenia.

Ciekawe materiały o SEO

Wzlot i upadek Grokipedii w Searchu

Jakkolwiek mój związek z Wikipedią to typowe love-hate relationship, trudno znaleźć mi sensowne powody, aby używać do czegokolwiek Grokipedii. Nie przeszkodziło to jednak w niepokojącym wzroście tego tworu w SERP-ach (link z nagłówka do krótkiego przeglądu styczniowych danych z Sistrix) oraz cytowaniu wynalazku Elona Muska przez ChatGPT (bardzo fajny artykuł z The Guardian). Najnowsze doniesienia z Search Engine Roundtable pokazują jednak, że po krótkotrwałym wzlocie następuje dość satysfakcjonujący upadek.

Praktyczne spojrzenie na Personal Intelligence

Mimo iż szanse na większy sukces Personal Intelligence napędzanego Gemini oraz danymi gromadzonymi o nas przez Google oceniam raczej mizernie, fajnie przyjrzeć się, jak usługa udostępniana użytkownikom w USA wygląda w praktyce. Bardzo ciekawy przegląd funkcji oraz rzeczywistego użycia zaprezentował Glenn Gabe.

Sześć poziomów demonstrowania danych budzących zaufanie

Jakkolwiek nie mam zaufania, czy tutaj nie mamy do czynienia z prostym podsumowaniem LLM-owym, tak materiał sam w sobie bardzo fajny. To rozpiska sześciu warstw źródłowych, z których warto korzystać przy tworzeniu treści mających budować zaufanie (kontekst jest mocno AI Search, ale imho sedno wykracza poza ten obszar).

Tak do tematów YMYL podchodzą różne narzędzia AI Search

Statystyki statystykami, ale każda analiza działania mechanizmów Search powinna mieć także oparcie w spojrzeniu z perspektywy konkretnych zapytań. Właśnie taki przegląd odpowiedzi na pytania YMYL udzielane przez ChatGPT, AI Overview, AI Mode, Gemini oraz Perplexity proponuje Francine Monahan z iPullRank.

Odświeżone wytyczne Google Discover

Pod kątem informacyjnym materiały na temat update'u Google Discover nie prezentują się jeszcze zbyt imponująco (oczywiście oprócz standardowego AI Slopu, w którym efekty aktualizacji są omawiane chwilę po jej wdrożeniu), ale w wielu branżowych mediach wychwycono ciekawą zmianę z wytycznych Google Discover w dokumentacji. Trafiły do niej m.in. sformułowania nazywające rzeczy po imieniu ("clickbait" oraz "sensationalism" w miejsce dotychczasowych eufemizmów) oraz odesłanie do ustępu dokumentacji poświęconemu page experience.

Google Maps coraz częściej blokuje możliwość zamieszczania recenzji

Claudia Tomina pokazuje na realnych przykładach sytuacje, w których Google blokuje możliwość zamieszczania recenzji w firmowym profilu w Mapach ze względu na podejrzaną aktywność. Ma również kilka hipotez, czemu i w jaki sposób się to dzieje.

Wykorzystanie danych z crawli

Przyznam się Wam do czegoś: crawle to rzecz, która przekonała mnie do wyboru obecnej ścieżki zawodowej. Wszyscy dookoła zapierdalali, a seowcy zawsze mieli czas na kawkę i fajeczkę, bo puścili właśnie crawla i czekali na wyniki xD A tak zupełnie na poważnie, to crawle są olbrzymim źródłem wiedzy, które mam wrażenie nie zawsze jest w stu procentach wykorzystywane. Na blogu Sitebulb pojawił się przegląd kilku sposobów na wykorzystywanie danych z crawli, które wykraczają poza standardowe punkty do odhaczenia z listy.

Megabajty w HTML jak pyszny zmrożony płyn

Ostatnie uściślenie limitu plików HTML odbieranych przez googlebota nieprzesadnie kogokolwiek obeszło, albowiem instynktownie wszyscy wiemy, że z 2 MB na HTML jest jak z pysznym, niemal zmrożonym płynem. Jakkolwiek byś się nie nastawiał przed imprezą, do 2 litrów raczej nie dobijesz, a i dociągnięcie do 0.5 sprawić może niekiedy problem. Dave Smart z Tame the Bots sprawdził, jak wygląda to w praktyce (HTML, nie limit przyjmowania płynu) i okazuje się, że trzeba się zbliżyć do setnego percentyla, żeby znaleźć w internecie tak przeładowane pliki.

Fantastyczny Project Claude do szukania Information Gain

O ile budowanie naprawdę dobrych i sensownych w użytkowaniu skilli w Claude niekoniecznie jest najlepszą inwestycją czasową, tego samego nie mogę powiedzieć o Projektach. To funkcjonalność przypominająca Custom GPTs czy Gemy z Gemini, z której korzystam co najmniej kika razy w tygodniu. Steve Toth przygotował wytyczne dla Projectu polegającego na wyszukiwaniu informacji umykających w podstawowym researchu, ponieważ rozsianych po zaindeksowanych w Google plikach .pdf czy .pptx. Przepotężne narzędzie.

Raporty, badania, case studies

Dane z GSC niekompletne nawet w 75%

To temat, który wraca co kilka miesięcy, ale zawsze miło spojrzeć na świeże statystyki. Tym bardziej, że w badaniu Kevina Indiga całkiem interesujący kawałek został poświęcony ruchowi botów, który generować ma nawet 6,5% danych (co jest w moim odczuciu i tak sporo niedoszacowane).

Anonimowe zapytania w GSC sięgają 47% zapytań

Na nieco inny aspekt tematu niekompletności danych z GSC zwracają uwagę statystyki przytoczone na blogu Ahrefs. O ile nie wiemy, czy taka metodologia jest stosowana w samym GSC, Patrick Stox przytacza klasyfikację zapytań jako anonimowe na potrzeby DMA. Mają to być zapytania, które nie były wyszukiwane więcej niż 30 razy w przeciągu ostatnich 13 miesięcy przez 30 różnych zalogowanych użytkowników. To z kolei jest dla mnie wystarczająco solidnym argumentem, aby wszelkie strategie polegające na celowaniu w zapytania z długiego ogona opierały się nie na danych z GSC lub narzędzi SEO, lecz kompleksowym pokryciu tematu.

Ruch z Google'a większy o 190 razy niż z ChataGPT

Mimo iż dzienna liczba przetwarzanych przez ChatGPT promptów (2,5 mld) stanowi 18% dziennej liczby wyszukiwań Google (13,7 mld), produkt giganta z Mountain View przekierowuje na strony internetowe ponad 190x więcej ruchu. Ten z ChataGPT stanowi zaledwie 0,21% referrali. Ciekawych statystyk w badaniu Ahrefsa jest jednak znacznie więcej, a mnie szczególnie zaskoczyła estymacja, że jako wyszukiwarka ChatGPT może być już używany częściej niż Bing!

Wykorzystanie Reddita w strategii AI Search [Case Study]

Jako że AI Search jeszcze długo (być może nigdy) nie wyjdzie ze swojej Parasite Era, wszystkie osoby myślące o wykrajaniu tortu z odpowiedzi AI muszą uzbroić się w umiejętności związane z docieraniem do obszarów poza własną domeną. Matt Diggity pokazuje w case study firmy informatycznej, jak wyglądają skuteczne działania na Reddicie.

Przegląd Google Discover na rynku francuskim

Moje ostatnie zainteresowanie materiałami SEO z rynku francuskiego doprowadza mnie do wielu interesujących hipotez. Jedna z nich, choć formułuję ją dość ostrożnie, mówi o sporym podobieństwie feedu discoverowego w Polsce i we Francji. Warto więc przyjrzeć się szerszemu przeglądowi tego rynku pod kątem Google Discover (biorąc jednocześnie pod uwagę, że raport bazuje na danych z Discover Snoop, a gorszego narzędzia do monitoringu Discovera nie widziałem).

Newsy z branży SEO i AI

Google proponuje WebMCP, czyli nowy protokół komunikacji międzyagentowej

Google dodaje nowe opcje do funkcji "Wyniki wyszukiwania informacji o Tobie"

OpenAI Frontier ma być systemem do wdrażania agentów AI w przedsiębiorstwach

OpenAI oficjalnie rusza z testem reklam w ChatGPT Free i Go w USA

Postaw mi kawkę

Jako że przygotowanie materiałów do MałySEO Newslettera zajmuje nieco czasu i zapewne widać to po treści dzisiejszego wpisu, może zaświtać Ci w głowie dość miły z mojej perspektywy pomysł drobnego rewanżu. Jeżeli uznasz, że lektura tego odcinka była dla Ciebie czymś więcej, niż tylko szybkim odklepaniem branżowych newsów, możesz postawić mi kawkę na buycoffee.to. Z góry dziękuję!